هل شاهدت فيديو يظهر مارك زوكربيرغ يتباهى بـ”السيطرة الكاملة على بيانات مليارات الأشخاص المسروقة”، أو باراك أوباما يصف دونالد ترامب بأنه “المغفل التام”، أو شاهدت اعتذارًا من الممثل المؤثر جون سنو، عن النهاية الكئيبة لمسلسل Game of Thrones؟ اذا اجبت بنعم فهذا يعني أنك تعرضت للتزييف العميق “deepfakes”.

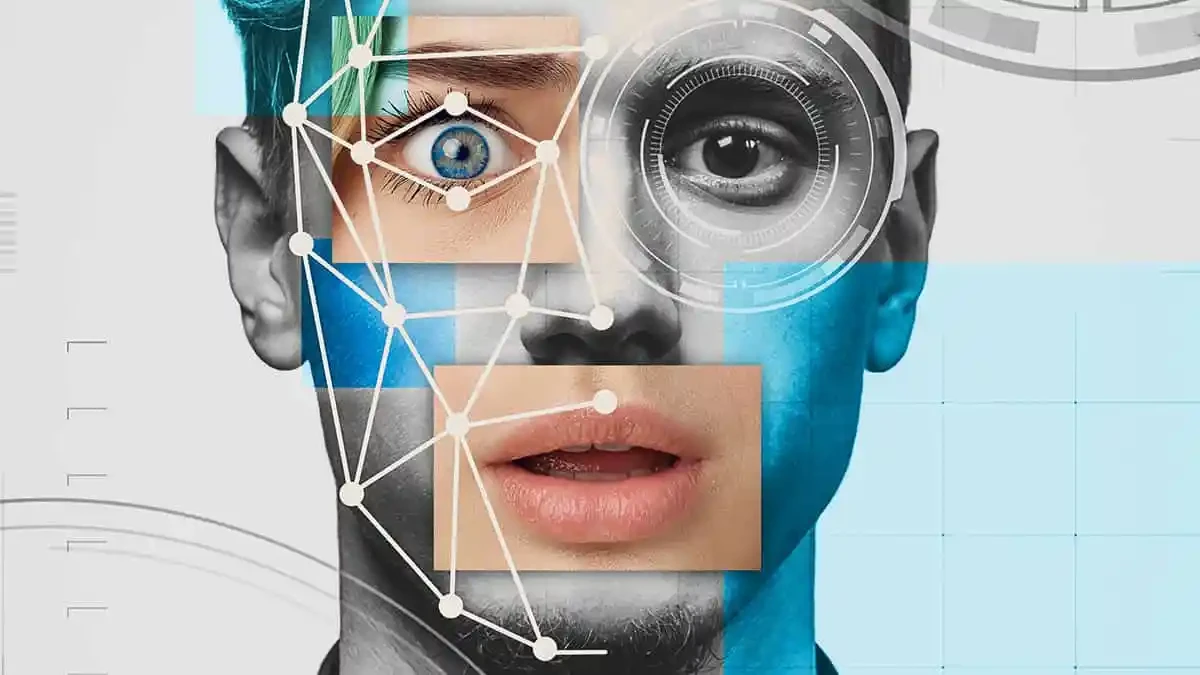

يُعد التزييف العميق إجابة القرن الحادي والعشرين على Photoshopping، ويستخدم تقنية الذكاء الاصطناعي المعروفة باسم التزييف العميق لإنشاء صور مزيفة وواقعية لأحداث لم تحدث بالفعل، ومن هنا جاء اسمه “deepfakes” لصناعة صور لاحداث مزيفة. هل ترغب في وضع كلمات جديدة في فم سياسي، أو وجه نجم في فيلمك المفضل، أو حتى الرقص مثل المحترفين؟ إذًا حان الوقت لاستخدام التزييف العميق.

هل الأمر يتعلق فقط بالفيديوهات؟

لا. يمكن لتقنية Deepfake إنشاء صور مقنعة ولكنها غير حقيقية تمامًا من البداية. ربما تكون الصحفية المزيفة لدى بلومبيرج “مايسي كينسلي” والتي تمتلك ملف شخصي على Twitter وLinkedIn غير موجودة وزائفة، وتم انشاؤها عبر تقنية deepfakes.

وفي مثال اخر، زعمت الشخصية الزائفة في شركة LinkedIn “كاتي جونز” ، أنها تعمل في مركز الدراسات الاستراتيجية والدولية ، ولكن يُعتقد أنها مزيفة تم إنشاؤها لعملية تجسس أجنبية.

تظهر جميع هذه الأمثلة خطورة استخدام تقنية deepfakes لإنشاء هويات وأحداث مزيفة قد تؤدي إلى التضليل والخداع.

ويمكن أيضاً تزييف الصوت، لإنشاء “أشكال صوتية” أو “نسخ صوتية” لشخصيات عامة. مثلما حدث في آذار (مارس) الماضي، عندما دفع رئيس شركة تابعة لشركة ألمانية للطاقة في المملكة المتحدة ما يقرب من 200 ألف جنيه إسترليني في حساب مصرفي مجري بعد أن اتصل به محتال قام بتقليد صوت الرئيس التنفيذي الألماني.

وتعتقد شركات التأمين على الشركة أن الصوت كان مزيفًا، لكن الأدلة غير واضحة. وبحسب ما ورد استخدمت عمليات احتيال مماثلة رسائل صوتية مسجلة على WhatsApp.

كيف يتم صنعهم؟

لطالما دفعت استوديوهات المؤثرات الخاصة حدود ما هو ممكن من خلال التلاعب بالفيديو والصور. لكن التزييف العميق أنفسهم ولدوا في عام 2017 عندما نشر مستخدم Reddit يحمل نفس الاسم مقاطع إباحية مزيفة على الموقع. استبدلت مقاطع الفيديو وجوه المشاهير – Gal Gadot و Taylor Swift و Scarlett Johansson وغيرهم – إلى فناني الأداء الإباحي.

طوال الوقت، سعت الجامعات واستوديوهات المؤثرات الخاصة لتجاوز حدود الممكن من خلال التلاعب بالفيديو والصور. ومع ذلك، تم ابتكار التزييف العميق في عام 2017 عندما نشر مستخدم Reddit يحمل نفس الاسم مقاطع فيديو إباحية مزيفة على الموقع. حيث استخدم هذا المستخدم التكنولوجيا لاستبدال وجوه المشاهير مثل Gal Gadot وTaylor Swift وScarlett Johansson وآخرين بوجوه فناني أفلام إباحية.

يستغرق عمل فيديو مبادلة الوجه بضع خطوات فقط، جيث تشغل آلاف اللقطات لوجه شخصين من خلال خوارزمية الذكاء الاصطناعي “AI” تسمى المشفر.

يقوم المشفر بإيجاد أوجه التشابه بين وجهي الشخصين ويتعلمها، يثمم يقللها إلى ميزاتهما الشتركة، ويضغط الصور في العملية. ثم يتم تدريس خوارزمية ذكاء اصطناعي ثانية تسمى وحدة فك التشفير لاستعادة الوجوه من الصور المضغوطة.

نظرًا لاختلاف الوجوه ، يمكنك تدريب وحدة فك ترميز واحدة لاستعادة وجه الشخص الأول ، وجهاز فك ترميز آخر لاستعادة وجه الشخص الثاني.

ولإجراء تبديل الوجه ، يمكنك ببساطة تغذية الصور المشفرة في وحدة فك الترميز “الخاطئة”. على سبيل المثال ، يتم إدخال صورة مضغوطة لوجه الشخص “أ” في وحدة فك التشفير التي تم تدريبها على الشخص “ب”. ثم تعيد وحدة فك التشفير بناء وجه الشخص “ب” مع تعبيرات واتجاه الوجه أ. للحصول على مقطع فيديو مقنع ، يجب إجراء ذلك على كل إطار.

هناك طريقة أخرى لصنع تقنية التزييف العميق تستخدم ما يسمى بشبكة الخصومة التوليدية ، أو Gan.

تقوم تقنية Gan بوضع خوارزميتين للذكاء الاصطناعي ضد بعضهما البعض. الخوارزمية الأولى ، المعروفة باسم المولد ، تغذي ضوضاء عشوائية وتحولها إلى صورة. ثم تُضاف هذه الصورة الاصطناعية إلى سلسلة من الصور الحقيقية – للمشاهير ، على سبيل المثال – التي يتم إدخالها في الخوارزمية الثانية ، المعروفة باسم أداة التمييز.

وفي البداية ، لن تبدو الصور الاصطناعية مثل الوجوه. لكن كرر العملية مرات لا حصر لها ، مع ردود الفعل على الأداء ، وتحسن كل من أداة التمييز والمولد.

وبالنظر إلى عدد كافٍ من الدورات والتعليقات ، سيبدأ المولد في إنتاج وجوه واقعية تمامًا لمشاهير غير موجودين تمامًا.

من يقوم بعمل التزييف العميق؟

يستخدم الكثير من الأكاديميين والباحثين الصناعيين إلى هواة الهواة واستوديوهات المؤثرات البصرية تقنية deepfakes.

ةقد تكون الحكومات منخرطة في هذه التقنية أيضًا ، كجزء من استراتيجياتها عبر الإنترنت لتشويه سمعة الجماعات المتطرفة وتعطيلها ، أو إجراء اتصالات مع أفراد مستهدفين ، على سبيل المثال.

ما التكنولوجيا التي تحتاجها؟

من الصعب عمل تزييف عميق جيد على جهاز كمبيوتر عادي. حيث يتم إنشاء معظمها على أجهزة كمبيوتر سطح المكتب المتطورة باستخدام بطاقات رسومات قوية أو أفضل من ذلك باستخدام قوة الحوسبة في السحابة.

وتقلل هذه التقنية وقت المعالجة من أيام وأسابيع إلى ساعات. ولكنها تحتاج أيضًا إلى خبرة، على الأقل لتعديل مقاطع الفيديو المكتملة للحد من الوميض والعيوب البصرية الأخرى.

ومع ذلك، هناك الكثير من الأدوات المتاحة الآن لمساعدة الأشخاص في إنشاء التزييف العميق. حيث أنه هناك عدة شركات ستقوم بإنشائها بالنيابة عنك وستقوم بجميع عمليات المعالجة في السحابة الحاسوبية.

حتى أن هناك تطبيقاً للهواتف المحمولة، يدعى “Zao”، يتيح للمستخدمين إضافة وجوههم إلى قائمة شخصيات تلفزيونية وسينمائية تم تدريب النظام عليها.

كيف تكتشف التزييف العميق؟

أصبحت الأمور أكثر صعوبة مع تحسن التكنولوجيا. حيث أنه في عام 2018، اكتشف باحثون أمريكيون أن وجوه التزييف العميق لا تغمض عيونها بشكل طبيعي. ليس هذا مفاجئًا، فمعظم الصور تظهر الناس وعيونهم مفتوحة، لذلك لا يتعلم الخوارزميات عادة عن عملية اغماض العيون.

في البداية، بدت هذه المشكلة وكأنها حلاً مثالياً لمشكلة الكشف عن التزييف العميق. لكن لا يمر وقت طويل حتى ظهرت تزييفات عميقة تحتوي تغمض عيونها بشكل طبيعي. وهذه هي طبيعة اللعبة، حالما يتم الكشف عن نقطة ضعف، يتم إصلاحها.

من السهل الكشف عن التزييفات العميقة ذات جودة المنخفضة. حيث قد يكون تزامن الشفاه غير جيد، أو يكون لون البشرة غير متجانس. وقد يكون هناك وميض حول حواف الوجوه المنقولة.

وتكون التفاصيل الدقيقة، مثل الشعر، صعبة بشكل خاص للتزييفات العميقة لإعادة إنتاجها بشكل جيد، خاصة عندما تكون الخصلات مرئية على الحافة.

ويمكن أن تكون المجوهرات والأسنان المُرسَمَة بشكل سيء دليلاً، إضافة إلى تأثيرات الإضاءة الغريبة، مثل التناوب والانعكاسات على القزحية.

وتقوم الحكومات والجامعات وشركات التكنولوجيا بتمويل البحوث لاكتشاف التزييفات العميقة.

وانطلق تحدي لاكتشاف تقنية deepfakes، بدعم من مايكروسوفت وفيسبوك وأمازون. ويشمل فِرق البحث حول العالم المنافسة للوصول إلى الهيمنة في لعبة اكتشاف التزييفات العميقة.

هل تقنية deepfakes تنشر الفساد؟

يمكننا توقع المزيد من التزييفات العميقة التي تتضمن التحرش والترهيب والإهانة والتقويض والتخريب. ولكن هل ستؤدي التزييفات العميقة إلى حدوث أزمات دولية كبيرة؟ هنا الوضع غير واضح بالكامل.

فالتزييف العميق لزعيم عالمي لا يجب أن يضغط على الزر الأحمر الكبير ويؤدي إلى كارثة. كما أن تزييف صور الأقمار الصناعية لتجمع القوات على الحدود لن يسبب الكثير من المشاكل، حيث أن معظم الدول لديها أنظمة صور أمنية موثوقة خاصة بها.

وما زال هناك مجال واسع للتسبب في الفوضى. حيث انهارت أسهم شركة تسلا في وقت سابق عندما قام إيلون ماسك بتدخين بعض المخدرات في برنامج ويب مباشر.

وفي مثال اخر عاد دونالد ترامب مبكرًا من اجتماع حلف شمال الأطلسي عندما ظهرت لقطات حقيقية لزعماء دول آخرى يستهزئون به. هل ستؤدي التزييفات العميقة المعقولة إلى تحويل أسعار الأسهم، وتأثير الناخبين، وإثارة التوتر الديني؟ يبدو أنها رهان آمن.

هل ستزول الثقة؟

التأثير الأكثر خبثًا للتزييفات العميقة، جنبًا إلى جنب مع وسائل الإعلام الاصطناعية الأخرى والأخبار الكاذبة، هو خلق مجتمع يفتقر إلى الثقة، حيث لا يمكن للناس تمييز الحقيقة من الزيف، أو لم يعدوا يهتمون بذلك. وعندما تتآكل الثقة، يكون من الأسهل إثارة الشكوك حول أحداث معينة.

ورفض وزير الاتصالات في وقت سابق، في الكاميرون مقطع فيديو تعتقد منظمة العفو الدولية أنه يُظهر أخبارًا كاذبة ، ويُظهر جنود الكاميرون وهم يعدمون المدنيين.

ودونالد ترامب، الذي اعترف بالتباهي بالتعامل بطريقة غير لائقة مع أعضاء الجنس النسائي في محادثة مسجلة، ألمح في وقت لاحق إلى أن التسجيل ليس حقيقياً.

وفي مقابلة الأمير أندرو مع إيميلي ميتليس على قناة بي بي سي، شكك الأمير في صحة صورة التقطت مع فيرجينيا جيفري، وهي صورة تصر محاميها على أنها حقيقية وغير معدلة.

مع تزايد إمكانية الوصول إلى التكنولوجيا، قد تشكل تقنية deepfakes مشكلة للمحاكم، ولا سيما في قضايا حضانة الأطفال والمحاكم العمالية، حيث يمكن أن تُقَدَّم الأحداث المُزيَّفة كدليل.

ولكنها تشكل أيضًا خطرًا على الأمان الشخصي، حيث يمكن للتزييفات العميقة تقليد البيانات البيومترية والتلاعب بالنظم التي تعتمد على التعرف على الوجه أو الصوت أو الأوردة أو المشية.

وتعد احتمالية حدوث عمليات احتيال واضحة. فإذا اتصل شخص غريب بك بشكل مفاجئ، فمن الغير طبيعي أن يحوّل أمواله إلى حسابك المصرفي. ولكن ماذا لو قامت “أمك” أو “أختك” بإعداد مكالمة فيديو عبر تطبيق واتساب وقدمت لك نفس الطلب؟

ما هو الحل؟

من الغريب أن الذكاء الاصطناعي قد يكون الحلا. فالذكاء الاصطناعي يساعد بالفعل في اكتشاف الفيديوهات المزيفة، ولكن العديد من أنظمة الكشف الموجودة لديها نقص خطير، فهي تعمل بشكل أفضل للمشاهير، لأنه يمكن تدريبها على ساعات من اللقطات المتاحة مجاناً.

وتعمل شركات التكنولوجيا الآن على أنظمة الكشف التي تهدف إلى تحذير من التزييفات في كل مرة تظهر فيها. وتركز استراتيجية أخرى على مصدر المحتوى.

بالإضافة إلى أن علامات الماء الرقمية ليست مضمونة بالتأكيد، ولكن نظام دفتر الأستاذ الإلكتروني (البلوكشين) يمكن أن يحمل سجلًا غير قابل للتلاعب للفيديوهات والصور والملفات الصوتية، بحيث يمكن التحقق دائمًا من أصلها وأي تلاعب بها.

هل تقنية deepfakes ضارة دائمًا؟

مُطْلَقاً، كثير من التزييفات العميقة مسلية وبعضها مفيد. ويمكن لتزوير الأصوات الصوتية أن يعيد أصوات الناس عندما يفقدونها بسبب المرض. ويمكن لفيديوهات التزييف العميق إضفاء الحيوية على المعارض والمتاحف.

ويحتوي متحف دالي في ولاية فلوريدا، على فيديو تزييف عميق للرسام السريالي يقدم أعماله الفنية ويأخذ صورًا سيلفي مع الزوار.

وبالنسبة لصناعة الترفيه، يمكن استخدام التكنولوجيا لتحسين الترجمة الصوتية في الأفلام باللغات الأجنبية، وبطريقة مثيرة للجدل، وإعادة إحياء الممثلين المتوفين.

ماذا عن التزييفات السطحية؟

أُطلق مصطلح “التزييفات السطحية” (shallowfakes) من قِبل سام غريغوري في منظمة حقوق الإنسان Witness، وهي فيديوهات يتم عرضها بدون سياق أو تم تعديلها باستخدام أدوات تحرير بسيطة.

وتعد التزييفات السطحية تكنولوجيا بدائية ولكنها بالتأكيد لها تأثير. حيث وصل فيديو تزييفي سطحي يُبطِّئ كلام نانسي بيلوسي وجعلها تبدو وكأنها تتلعثم إلى الملايين على وسائل التواصل الاجتماعي.

وفي حادثة أخرى، استخدم حزب المحافظين في المملكة المتحدة تكتيكات زائفة ضحلة. حيث قام المحافظون قبل الانتخابات الأخيرة، بتزوير مقابلة تلفزيونية مع النائب العمالي كير ستارمر ليبدو وكأنه غير قادر على الإجابة عن سؤال حول موقف الحزب من الخروج من الاتحاد الأوروبي (بريكسيت).