في ظل التحذيرات الصادرة عن خبراء ورجال أعمال في قطاع الذكاء الاصطناعي المزدهر، تكثر الأسئلة حول مدى دقة مقولة أن الذكاء الاصطناعي يهدد البشرية بـ"الفناء"؛ فهل من صدقية لهذا السيناريو الكارثي الذي لا يزال، لو صحّ فعلاً، يلوح في الأفق البعيد؟

يبدأ الكابوس، المستوحى من عدد لا يحصى من أفلام الخيال العلمي، عندما تتفوق الآلة بقدراتها على البشر وتخرج عن نطاق السيطرة. وقال أحد عرّابي التعلم الآلي، الباحث الكندي يوشوا بنجيو، في تصريحات أدلى بها مؤخرا إنه "منذ اللحظة التي ستكون لدينا آلات مصممة لكي تستمرّ، سنواجه مشاكل".

وبحسب متغير تخيله الفيلسوف السويدي نيك بوستروم، ستأتي اللحظة الحاسمة عندما تعرف الآلات كيف تصنع آلات أخرى بنفسها، ما يتسبب في "انفجار في الذكاء". وفق نظريته التي سُميت بـ"نظرية مشبك الورق"، إذا كان للذكاء الاصطناعي على سبيل المثال هدف نهائي يتمثل في تحسين إنتاج إكسسوار القرطاسية هذا، فسوف ينتهي به الأمر بتغطية "الأرض أولاً ثم التمدد على أنحاء أكبر من الكون، بمشابك ورقية".

ونيك بوستروم هو نفسه شخصية مثيرة للجدل، إذ كان قد أكد أن البشرية يمكن أن تكون محاكاة حاسوبية، كما دعم نظريات وُضعت في خانة تحسين النسل. وقد اضطُرّ مؤخرا إلى الاعتذار عن رسالة عنصرية بعث بها في تسعينيات القرن الماضي وعادت إلى الظهور في الفترة الأخيرة.

ومع ذلك، فإن رؤيته حول مخاطر الذكاء الاصطناعي لا تزال مؤثرة للغاية، وقد ألهمت كلاً من رئيس شركتي تيسلا وسبايس إكس، الملياردير إيلون ماسك، والفيزيائي ستيفن هوكينغ، الذي توفي في عام 2018.

وصورة المقاتل الآلي ذي العينين الحمراوين من فيلم "ترمينايتر" ("Terminator")، والذي أرسله ذكاء اصطناعي مستقبلي لوضع حد لكل مقاومة بشرية، طبعت اللاوعي الجماعي بصورة كبيرة. لكن وفق خبراء حملة "أوقفوا الروبوتات القاتلة" ("Stop Killer Robots")، فإن هذا ليس الشكل الذي ستسود به الأسلحة المستقلة في السنوات المقبلة، وفق ما كتبوا في تقرير صادر عام 2021.

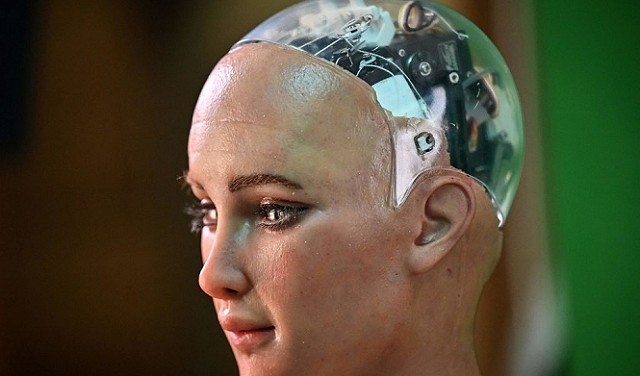

وتطمئن اختصاصية الروبوتات، كيرستين دوتنهان، من جامعة واترلو في كندا، في مقابلة مع وكالة "فرانس برس"، بأنّ "الذكاء الاصطناعي لن يمنح الآلات الرغبة في قتل البشر". وتقول "الروبوتات ليست شريرة"، مقرّة في الوقت عينه بأنّ مطوريها يمكن أن يبرمجوها لإلحاق الأذى.

والسيناريو الأقل وضوحا يتضمن استخدام الذكاء الاصطناعي لإنتاج سموم أو فيروسات جديدة بهدف نشرها في جميع أنحاء العالم. وقد أجرت مجموعة من العلماء الذين استخدموا الذكاء الاصطناعي لاكتشاف عقاقير جديدة، تجربة عدّلوا فيها بحوثهم بهدف تطوير جزيئات ضارة.

وفي أقل من ست ساعات، تمكنوا من إنتاج 40 ألف عامل يُحتمل أن يكون سامًا، وفق مقال نُشر في مجلة "نيتشر ماشين إنتلجنس". وقالت خبيرة الذكاء الاصطناعي في مدرسة هيرتي في برلين، جوانا برايسون، إنه باستخدام هذه التقنيات، قد يجدُ شخص ما طريقة لنشر فيروسات أو سموم مثل الجمرة الخبيثة بشكل أسرع.

وقالت لوكالة "فرانس برس" "لكنه ليس تهديدًا وجوديًا، بل فقط سلاح رهيب".

وفي أفلام نهاية العالم، تحدثُ الكارثة فجأة وفي كل مكان دفعة واحدة. ولكن ماذا لو اختفت البشرية تدريجيًا واستُبدلت بالآلات؟

يتوقع الفيلسوف هو برايس، في شريط فيديو ترويجي نشره مركز دراسة المخاطر الوجودية في جامعة كامبريدج، أنه "في أسوأ الأحوال، يمكن أن يموت جنسنا البشري من دون خليفة لنا".

ومع ذلك، هناك "احتمالات أقل سوداوية"، يمكن فيها للبشر المعززين بالتكنولوجيا المتقدمة البقاء على قيد الحياة. ويضيف برايس: "الأنواع البيولوجية البحتة تنتهي بالانقراض".

وفي عام 2014، قال ستيفن هوكينغ إن جنسنا البشري سيعجز يومًا عن منافسة الآلات. وأوضح لهيئة "بي بي سي" البريطانية أن هذا من شأنه أن "يمهّد لفناء الجنس البشري".

أما جيفري هينتون، الباحث الذي يحاول إنشاء آلات تشبه الدماغ البشري لحساب مجموعة غوغل، فتحدث أخيرًا بعبارات مماثلة عن "ذكاء خارق" يتفوق على البشر. وأكد على قناة "بي بي إس" الأميركية، أن من الممكن أن "تكون الإنسانية مجرد مرحلة عابرة في تطور الذكاء".